Title Text:If most people turn into murderers all of a sudden, we’ll need to push out a firmware update or something.

Origin:https://xkcd.com/1958/

https://www.explainxkcd.com/wiki/index.php/1958:_Self-Driving_Issues

无人驾驶汽车的安全问题

https://mp.weixin.qq.com/s/Gw2G4bA3-vArFRVlNWTZ0w

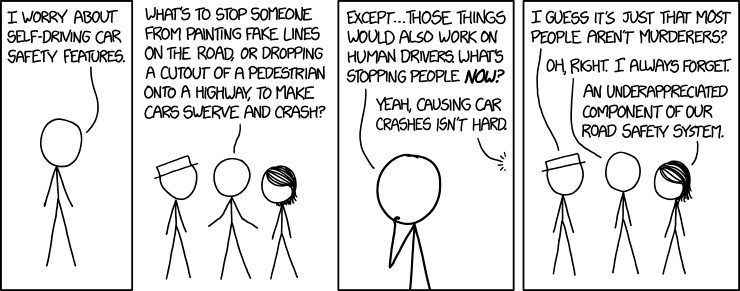

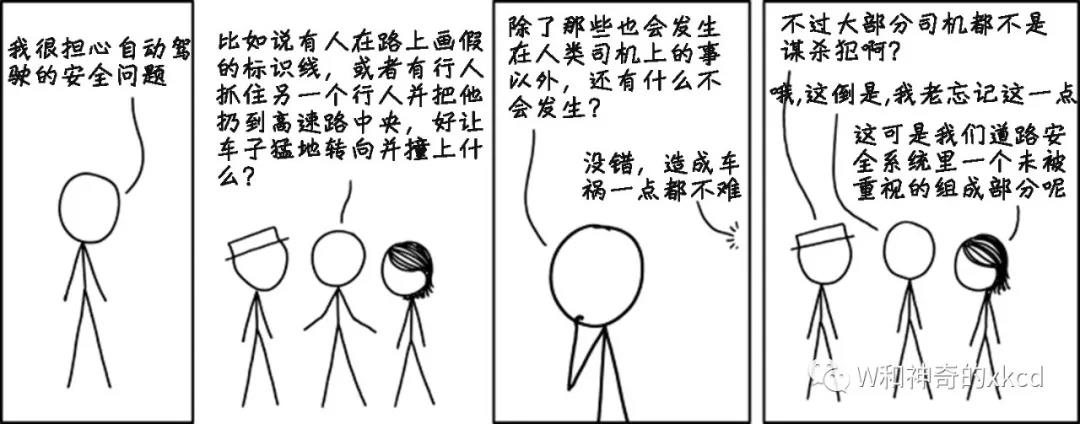

Cueball解释说担心自动驾驶汽车,并指出有可能愚弄车辆的感官系统。这是AI的共同关注点;因为他们在分析上思考并且几乎没有抽象思维的能力,所以他们可以被人类立刻意识到的具有欺骗性的东西所欺骗。

然而,Cueball很快就认为,在将AI驱动程序与人类驱动程序进行比较时,他的论点实际上并不成立,因为两者都依赖于相同的指导框架。人类驾驶员遵循标志和道路标记,并且必须遵守AI必须遵守的道路规律。因此,对道路基础设施的攻击可能会影响AI和人类。然而,人类和AI并不是同样脆弱的。例如,一个假的标志或一个假的孩子可能在人类看来是一个明显的假,但傻瓜AI。创意攻击者可以使用类似CAPTCHA的文本标记,该文本可由人类读取,但不能由AI读取。

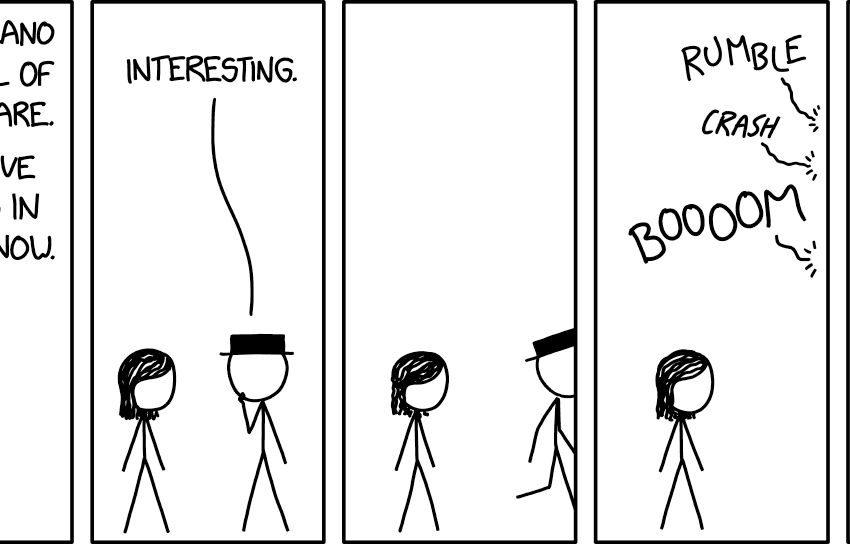

Cueball进一步想知道为什么,在这种情况下,没有人试图愚弄人类司机,因为他们可能试图欺骗人工智能,但White Hat和Megan指出了最明显的答案:大多数道路安全系统受益于人类没有积极地试图恶意破坏它们只是为了引发事故。

标题文本继续推理,注意到如果大多数人突然成为凶手,人工智能可能需要进行升级,以便通过愚弄AI来处理试图导致车祸的人的可能增加 – 有点狭窄考虑到一个充满凶手的世界可能会有更多的问题而不是那个问题。由于梅根认为人类是道路安全系统的“组成部分”,它可能也会建议为那些全都成为凶手的人提供固件更新,这些人可以解决他们的杀人方式。目前,我们还无法为大量人群创建和应用即时固件更新;据我们所知,甚至将我们掌握的所有行为修改工具 – 精神病学,认知行为疗法,催眠,改变思维的药物,监狱,CRISPR等 – 结合起来还不足以完成如此大规模的工作。更新可能与汽车的固件有关,因为它可用于禁用中断,从而导致或预防许多人死亡。