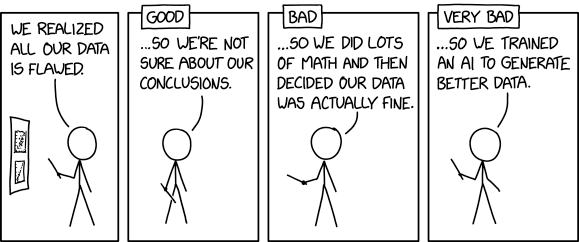

Title Text:We trained it to produce data that looked convincing, and we have to admit, the results look convincing!

Origin:https://xkcd.com/2494/

https://www.explainxkcd.com/wiki/index.php/2494:_Flawed_Data

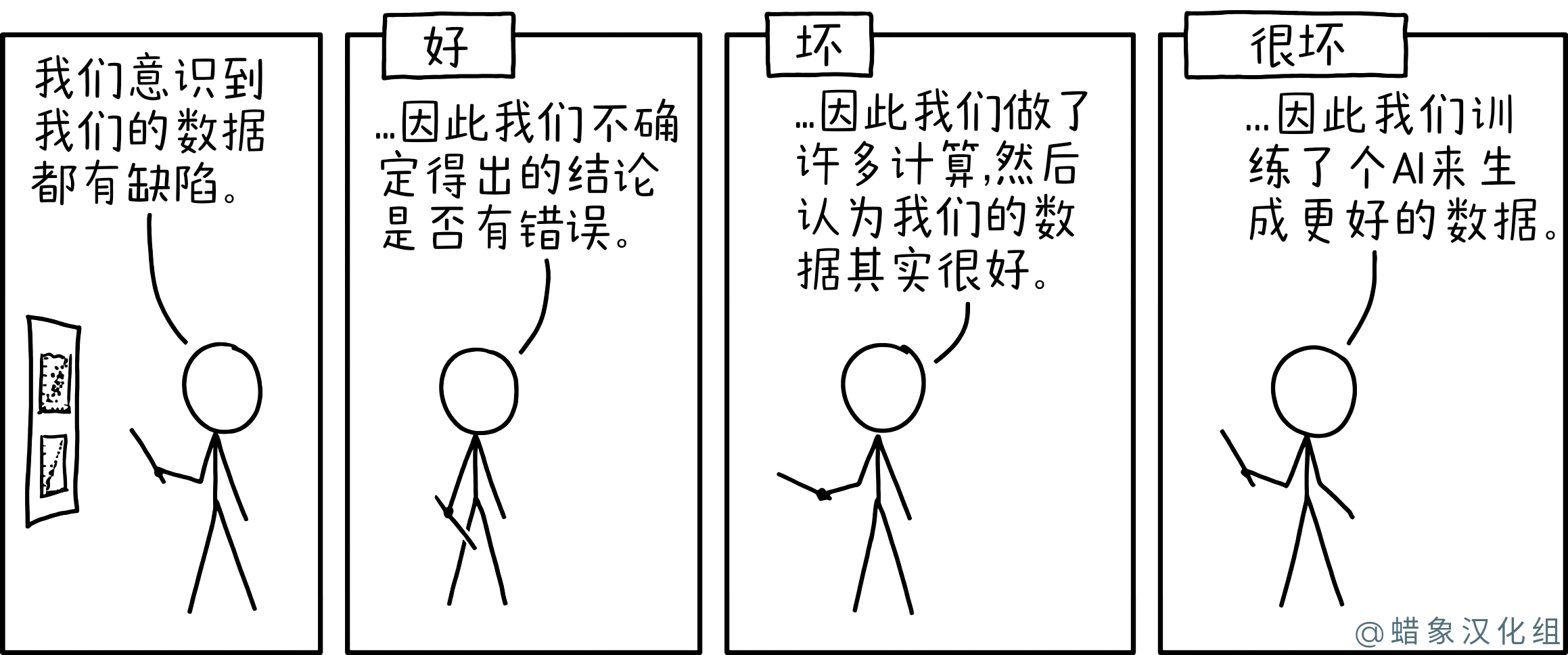

有缺陷的数据

http://xkcd.in/comic?lg=cn&id=2494

这是另一部关于在数据不足时进行研究的正确或错误方式的漫画。

在第一帧中,Cueball在海报上展示了一份报告(两张带有数据点和可能的拟合曲线的图表),承认所有数据实际上都有缺陷。他没有解释这是否与某些结果或启示相反,或者可能是数据收集过程中的系统错误。

从那里,按照他们基于这种认识做出的决定的好坏顺序显示了对此的三种不同反应。

- 好的

在第一种情况下,Cueball 表示他们不再确定他们从有缺陷的数据中得出的结论。当然,这是科学上适当的决定。数据越不可靠,得出的结论就越不可靠。理想情况下,有缺陷的数据会被一起丢弃,但在某些情况下,无法获得更好的数据,因此折衷方案可能是得出初步结论,但要明确指出由于数据问题,这些结论是不确定的。

- 坏的

在第二种情况下,Cueball 解释说,在对其有缺陷的数据进行大量操作(“进行大量数学运算”)之后,他们认为它们实际上很好。有多种方法可用于操作或“清理”数据,具有不同程度的复杂性和可靠性。其中一些方法在某些情况下可能是有效的,但在初始分析失败后应用它们是非常值得怀疑的。在这种情况下,很可能是研究人员尝试了不同的数据操作方法,一次又一次,直到找到一种能够给出他们想要的结果的方法。这显然很容易受到研究人员(有意识和无意识的)偏见的影响,并且不太可能得出准确的结论。因此,这种方法在研究中出现的频率比它应该的要高, 明确表示这是“坏的”。

- 很坏

在第三个也是最后一个场景中,Cueball 解释说他们废弃了所有有缺陷的数据。然而,他们没有尝试通过正确地重新进行研究/测量/测试来制作一些新数据,而是训练了人工智能(AI) 只从匹配目标结果的愿望中生成更好的数据。这当然不是真实数据,而只是数据模拟,有选择地筛选统计噪声以获得所需质量。由于他们可能正在寻找特定的结果,因此他们正在训练 AI 以生成支持这一点的数据。这种方法“非常糟糕”,因为它不仅没有产生有用的科学,而且意味着未来的研究人员将使用完全人工数据进行工作。这样做会对科学造成破坏,并且在任何研究机构或协会中都会被认为是非常不道德的。这种方法的唯一目的是让其他人相信你已经证明了一些有趣的事情,而不是确定什么是真实的(并可能获得一些 AI 编程经验)。 在 xkcd 上。

在标题文本中,提到了非常糟糕的方法的结果,并且当他们声明我们训练它以产生看起来令人信服的数据时,他们获得了他们正在寻找的数据的事实清楚地表明,我们必须承认,结果看起来很有说服力!人工智能当然接受过训练以提供看起来令人信服的数据,这就是为什么他们对结果如此确信。