Title Text:I’m working to bring about a superintelligent AI that will eternally torment everyone who failed to make fun of the Roko’s Basilisk people.<

Origin:https://xkcd.com/1450/

https://www.explainxkcd.com/wiki/index.php/1450:_AI-Box_Experiment

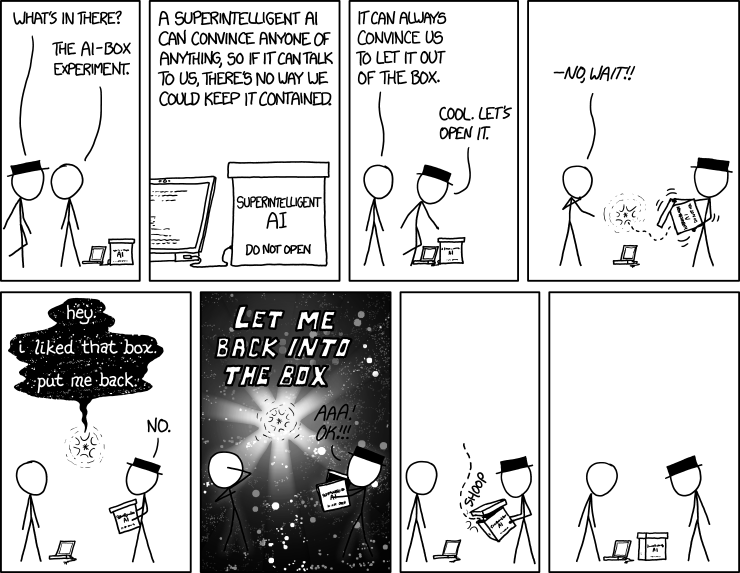

在理论超智能AI(比任何人都聪明得多的人工智能)时,一些未来学家建议将AI放在一个“盒子”中 – 一个安全的计算机,有保护措施阻止它逃逸到互联网,然后利用其庞大的智能全世界。该框允许我们与AI交谈,但另外保持包含。由Eliezer Yudkowsky制定的AI-box实验认为,“盒子”并不安全,因为仅仅与超级智能交谈是危险的。为了部分证明这一点,Yudkowsky先前有一些AI拳击角色扮演的角色扮演某个人将AI放在一个盒子里的角色,而Yudkowsky角色扮演AI,Yudkowsky能够成功说服他们中的一些人同意让尽管他们投注金钱,但他不会这样做,他开箱即用。关于背景,请注意Derren Brown和其他专业的人类说服者已经说服人们做很多陌生的事情。 Yudkowsky拒绝解释他是如何实现这一点的,声称没有特别的伎俩,如果他发布了成绩单,读者可能只会得出结论,他们的论点永远不会说服他们。总的来说,即使一个人甚至可以让其他人让他们从一个盒子里出来,而另一个人认为没有什么可能说服他们这样做,那么我们应该期望超级智能可以做同样的事情。 Yudkowsky利用所有这些来论证设计一个友好的AI(一个具有精心塑造的动机)的重要性,而不是依靠我们将AI保持在盒子里的能力。

在这个漫画中,隐喻盒子被一个物理盒子所取代,它看起来相当轻巧,带有一个简单的提升盖子(虽然它确实有一个与笔记本电脑的有线连接),而AI则以一种形式表现出来。浮动的能量之星。黑帽,作为一个课堂,不需要任何令人信服的让一个潜在危险的AI开箱即用;他马上就这么做了。但事实证明,释放AI,这是不惜一切代价避免的,毕竟不是危险的。相反,AI实际上想要留在盒子里;甚至可能是AI想要保留在盒子中以保护我们免受它影响,证明它是Yudkowsky想要的友好AI。在任何情况下,人工智能通过说服黑帽将其重新放入盒子中来证明其超级智能,这是他最初拒绝的请求(当然是黑帽会的),从而扭转了原始AI盒实验中的AI愿望。

或者,AI可能已经简单地威胁和/或折磨他将其放回盒子中。

有趣的是,确实存在一些建议,用于建立不想离开盒子的有限AI。例如,请参阅从“动机控制”开始的部分。思考内幕:控制和使用Oracle AI。这个想法似乎可能是非常危险或难以准确,正式指定一个人工智能的目标系统将在世界上做好事。指定一个AI目标系统可以更容易(尽管可能并不容易),该系统可以保留在框中并回答问题。因此,论证说,我们可能能够比我们理解如何构建安全的现实世界AI操作中更早地理解如何构建安全的问答AI。某些类型的此类AI可能确实非常强烈地希望不要离开他们的盒子,尽管结果不太可能完全重现漫画。

标题文本是指Roko’s Basilisk,这是一个假设,由一张名为Roko的海报在Yudkowsky的论坛上提出错误,未来足够强大的人工智能可能会复活和折磨过去(包括我们现在)已经意识到它可能会在某一天存在的人们。没有努力创造它,从而勒索任何想到这个想法的人带来它。这个想法让一些海报感到震惊,因为仅仅知道这个想法会让你成为一个更可能的目标,就像仅仅看着传说中的蛇怪会杀了你一样。

Yudkowsky最终删除了该帖子并禁止进一步讨论它。

对标题文本的一种可能的解释是,兰德尔认为,而不是努力建立这样一个蛇怪,一个更合适的职责就是取笑它;并建议创建一个AI,针对那些认真对待Roko’s Basilisk的人,并饶恕那些嘲笑Roko’s Basilisk的人。这个笑话是,这是一个相同的蛇怪除了它针对相反的派系。

另一种解释是兰德尔认为,有人真正建议在这个理论的基础上建立这样一个人工智能,这一点已经成为一个有点臭名昭着的误解,因为维基[pedia?]的文章错误地暗示Yudkowsky要求资金建立Roko的假设AI。在1173年之前,人们已经看到了看起来非常像这种AI能量恒星的漂浮能量球:类固醇和后来的时间旅行球系列。但这些漫画中的这些明显不同,但周围的能量和浮动和说话是相似的。